10个实例,已经非常全面,而且还讲解了hdfs写入文件和读取文件的内部实现原理。非常好的一篇文章。

除了有一个读取HDFS某个目录下的所有文件的代码不全,其它都很完整。不全的那个我已经补上了。

//读取HDFS某个目录下的所有文件

Path fpath1 = new Path("/");

//fs.getPath(fpath1);

FileStatus[] status = fs.listStatus(fpath1);

for (FileStatus file : status) {

System.out.println(file.getPath().getName());

}

1.创建文件

过”FileSystem.create(Path f)”可在HDFS上创建文件,其中f为文件的完整路径。

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FSDataOutputStream;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassCreateFile {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- byte[] buff=”hello hadoop world!\n”.getBytes();

- Path dfs=newPath(“/test”);

- FSDataOutputStream outputStream=hdfs.create(dfs);

- outputStream.write(buff,0,buff.length);

- }

- }

复制代码

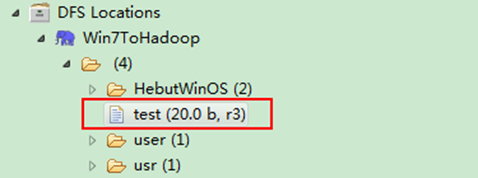

运行结果如图1-2-1和图1-2-2所示。

1)项目浏览器

图1-2-1 运行结果(1)

2)SecureCRT结果

图1-2-2 运行结果(2)

2 创建HDFS目录

通过”FileSystem.mkdirs(Path f)”可在HDFS上创建文件夹,其中f为文件夹的完整路径。具体实现如下:

- package com.hebut.dir;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassCreateDir {

- publicstaticvoidmain(String[] args) throws Exception{

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path dfs=newPath(“/TestDir”);

- hdfs.mkdirs(dfs);

- }

- }

复制代码

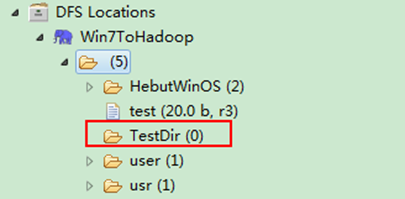

运行结果如图6-3-1和图6-3-2所示。

1)项目浏览器

图1-3-1 运行结果(1)

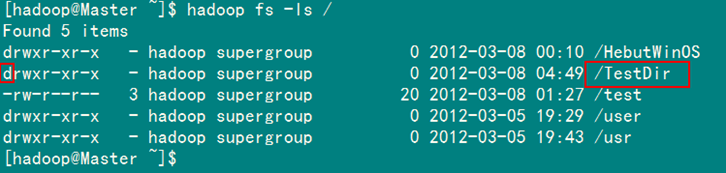

2)SecureCRT结果

图1-3-2 运行结果(2)

3 重命名HDFS文件

通过”FileSystem.rename(Path src,Path dst)”可为指定的HDFS文件重命名,其中src和dst均为文件的完整路径。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassRename{

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path frpaht=newPath(“/test”); //旧的文件名

- Path topath=newPath(“/test1”); //新的文件名

- boolean isRename=hdfs.rename(frpaht, topath);

- String result=isRename?”成功”:”失败”;

- System.out.println(“文件重命名结果为:”+result);

- }

- }

复制代码

运行结果如图6-4-1和图6-4-2所示。

1)项目浏览器

图1-4-1 运行结果(1)

2)SecureCRT结果

图1-4-2 运行结果(2)

4 删除HDFS上的文件

通过”FileSystem.delete(Path f,Boolean recursive)”可删除指定的HDFS文件,其中f为需要删除文件的完整路径,recuresive用来确定是否进行递归删除。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassDeleteFile {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path delef=newPath(“/test1”);

复制代码

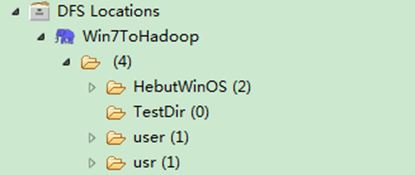

运行结果如图6-5-1和图6-5-2所示。

1)控制台结果

图1-5-1 运行结果(1)

2)项目浏览器

图6-5-2 运行结果(2)

5 删除HDFS上的目录

同删除文件代码一样,只是换成删除目录路径即可,如果目录下有文件,要进行递归删除。

6 查看某个HDFS文件是否存在

通过”FileSystem.exists(Path f)”可查看指定HDFS文件是否存在,其中f为文件的完整路径。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassCheckFile {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path findf=newPath(“/test1”);

- boolean isExists=hdfs.exists(findf);

- System.out.println(“Exist?”+isExists);

- }

- }

复制代码

运行结果如图1-7-1和图1-7-2所示。

图1-7-1 运行结果(1)

2)项目浏览器

图6-7-2 运行结果(2)

7 查看HDFS文件的最后修改时间

通过”FileSystem.getModificationTime()”可查看指定HDFS文件的修改时间。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileStatus;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassGetLTime {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path fpath =newPath(“/user/hadoop/test/file1.txt”);

- FileStatus fileStatus=hdfs.getFileStatus(fpath);

- longmodiTime=fileStatus.getModificationTime();

- System.out.println(“file1.txt的修改时间是”+modiTime);

- }

- }

复制代码

运行结果如图6-8-1所示。

图1-8-1 控制台结果

8读取HDFS某个目录下的所有文件

通过”FileStatus.getPath()”可查看指定HDFS中某个目录下所有文件。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileStatus;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

复制代码

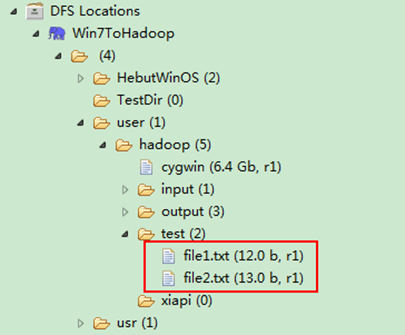

运行结果如图1-9-1和图1-9-2所示。

1)控制台结果

图1-9-1 运行结果(1)

2)项目浏览器

图1-9-2 运行结果(2)

9 查找某个文件在HDFS集群的位置

通过”FileSystem.getFileBlockLocation(FileStatus file,long start,long len)”可查找指定文件在HDFS集群上的位置,其中file为文件的完整路径,start和len来标识查找文件的路径。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.BlockLocation;

- import org.apache.hadoop.fs.FileStatus;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.fs.Path;

- publicclassFileLoc {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem hdfs=FileSystem.get(conf);

- Path fpath=newPath(“/user/hadoop/cygwin”);

- FileStatus filestatus = hdfs.getFileStatus(fpath);

- BlockLocation[] blkLocations = hdfs.getFileBlockLocations(filestatus, 0, filestatus.getLen());

- intblockLen = blkLocations.length;

- for(inti=0;i

- String[] hosts = blkLocations[i].getHosts();

- System.out.println(“block_”+i+”_location:”+hosts[0]);

- }

- }

- }

复制代码

运行结果如图1-10-1和1.10.2所示。

1)控制台结果

图1-10-1 运行结果(1)

2)项目浏览器

图1-10-2 运行结果(2)

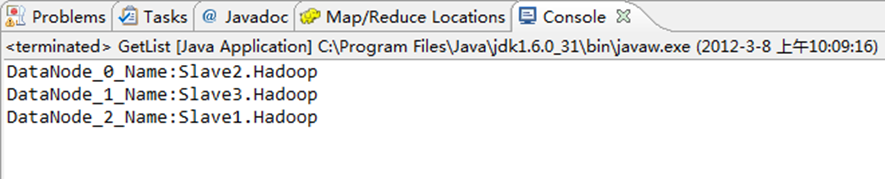

10获取HDFS集群上所有节点名称信息

通过”DatanodeInfo.getHostName()”可获取HDFS集群上的所有节点名称。具体实现如下:

- package com.hebut.file;

- import org.apache.hadoop.conf.Configuration;

- import org.apache.hadoop.fs.FileSystem;

- import org.apache.hadoop.hdfs.DistributedFileSystem;

- import org.apache.hadoop.hdfs.protocol.DatanodeInfo;

- publicclassGetList {

- publicstaticvoidmain(String[] args) throws Exception {

- Configuration conf=newConfiguration();

- FileSystem fs=FileSystem.get(conf);

- DistributedFileSystem hdfs = (DistributedFileSystem)fs;

- DatanodeInfo[] dataNodeStats = hdfs.getDataNodeStats();

- for(inti=0;i

- System.out.println(“DataNode_”+i+”_Name:”+dataNodeStats[i].getHostName());

- }

- }

- }

复制代码

运行结果如图1-11-1所示。

图6-11-1 控制台结果

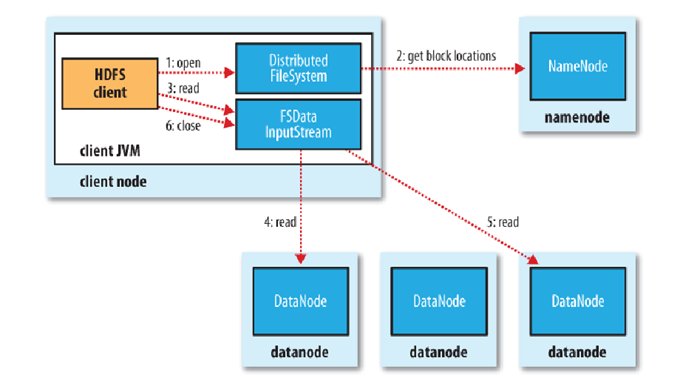

11HDFS的读写数据流11.1 文件的读取剖析

文件读取的过程如下:

1)解释一

客户端(client)用FileSystem的open()函数打开文件。

DistributedFileSystem用RPC调用元数据节点,得到文件的数据块信息。

对于每一个数据块,元数据节点返回保存数据块的数据节点的地址。

DistributedFileSystem返回FSDataInputStream给客户端,用来读取数据。

客户端调用stream的read()函数开始读取数据。

DFSInputStream连接保存此文件第一个数据块的最近的数据节点。

Data从数据节点读到客户端(client)。

当此数据块读取完毕时,DFSInputStream关闭和此数据节点的连接,然后连接此文件下一个数据块的最近的数据节点。

当客户端读取完毕数据的时候,调用FSDataInputStream的close函数。

在读取数据的过程中,如果客户端在与数据节点通信出现错误,则尝试连接包含此数据块的下一个数据节点。

失败的数据节点将被记录,以后不再连接。

2)解释二

使用HDFS提供的客户端开发库,向远程的Namenode发起RPC请求;

Namenode会视情况返回文件的部分或者全部block列表,对于每个block,Namenode都会返回有该block拷贝的datanode地址;

客户端开发库会选取离客户端最接近的datanode来读取block;

读取完当前block的数据后,关闭与当前的datanode连接,并为读取下一个block寻找最佳的datanode;

当读完列表的block后,且文件读取还没有结束,客户端开发库会继续向Namenode获取下一批的block列表。

读取完一个block都会进行checksum验证,如果读取datanode时出现错误,客户端会通知Namenode,然后再从下一个拥有该block拷贝的datanode继续读。

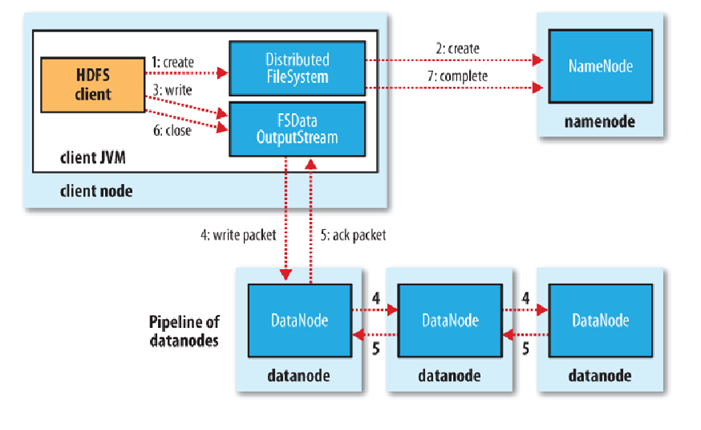

11.2 文件的写入剖析

写入文件的过程比读取较为复杂:

1)解释一

客户端调用create()来创建文件

DistributedFileSystem用RPC调用元数据节点,在文件系统的命名空间中创建一个新的文件。

元数据节点首先确定文件原来不存在,并且客户端有创建文件的权限,然后创建新文件。

DistributedFileSystem返回DFSOutputStream,客户端用于写数据。

客户端开始写入数据,DFSOutputStream将数据分成块,写入data queue。

Data queue由Data Streamer读取,并通知元数据节点分配数据节点,用来存储数据块(每块默认复制3块)。分配的数据节点放在一个pipeline里。

Data Streamer将数据块写入pipeline中的第一个数据节点。第一个数据节点将数据块发送给第二个数据节点。第二个数据节点将数据发送给第三个数据节点。

DFSOutputStream为发出去的数据块保存了ack queue,等待pipeline中的数据节点告知数据已经写入成功。

如果数据节点在写入的过程中失败:

关闭pipeline,将ack queue中的数据块放入data queue的开始。

当前的数据块在已经写入的数据节点中被元数据节点赋予新的标示,则错误节点重启后能够察觉其数据块是过时的,会被删除。

失败的数据节点从pipeline中移除,另外的数据块则写入pipeline中的另外两个数据节点。

元数据节点则被通知此数据块是复制块数不足,将来会再创建第三份备份。

当客户端结束写入数据,则调用stream的close函数。此操作将所有的数据块写入pipeline中的数据节点,并等待ack queue返回成功。最后通知元数据节点写入完毕。

2)解释二

使用HDFS提供的客户端开发库,向远程的Namenode发起RPC请求;

Namenode会检查要创建的文件是否已经存在,创建者是否有权限进行操作,成功则会为文件创建一个记录,否则会让客户端抛出异常;

当客户端开始写入文件的时候,开发库会将文件切分成多个packets,并在内部以”data queue”的形式管理这些packets,并向Namenode申请新的blocks,获取用来存储replicas的合适的datanodes列表,列表的大小根据在Namenode中对replication的设置而定。

开始以pipeline(管道)的形式将packet写入所有的replicas中。开发库把packet以流的方式写入第一个datanode,该datanode把该packet存储之后,再将其传递给在此pipeline中的下一个datanode,直到最后一个datanode,这种写数据的方式呈流水线的形式。

最后一个datanode成功存储之后会返回一个ack packet,在pipeline里传递至客户端,在客户端的开发库内部维护着”ack queue”,成功收到datanode返回的ack packet后会从”ack queue”移除相应的packet。

如果传输过程中,有某个datanode出现了故障,那么当前的pipeline会被关闭,出现故障的datanode会从当前的pipeline中移除,剩余的block会继续剩下的datanode中继续以pipeline的形式传输,同时Namenode会分配一个新的datanode,保持replicas设定的数量。